Prototyp I

Im Fokus des ersten Prototyps, der bei der Langen Nacht der Wissenschaften 2010 offiziell präsentiert wurde, lagen Gesichts- und Sprachsteuerung zweier Spieler. Die Entwicklungszeit umfasste dafür lediglich 16 Tage.

Autonomer Kindergarten

Die Simulation eines autonom laufenden Kindergartens war die erste Herausforderung, so können die Spieler den Kindern einfach nur zuschauen und sehen, wie sich teilweise chaotische Szenarien ergeben, bei denen sich die Kinder streiten oder traurig in der Ecke sitzen. Die Kinder sind dabei allerdings immer in der Lage, sich aus scheinbar festgefahrenen, ausweglosen Situationen eigenständig zu lösen.

In der aktuellen Version können zwei Spieler mit- oder gegeneinander spielen. Es gibt zwei Spielmöglichkeiten: der Innenraum und der Garten.

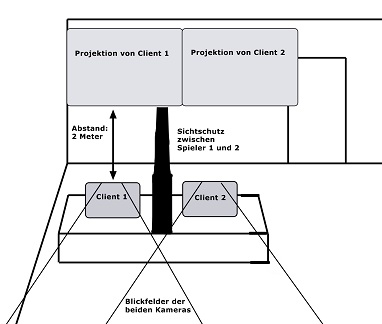

Die Spieler sitzen an zwei Rechnern, die jeweils einen der vorhandenen Spielbereiche über einen Beamer sehen.

Gesichtserkennung

Um den Kindern Aufmerksamkeit zu schenken, müssen diese zunächst angeschaut werden. Die Kalibrierung der handelsüblichen im Projekt eingesetzten Webcam findet voll automatisch statt.

Die komplexen Bildverarbeitungsmethoden, die auf der freien Bibliothek OpenCV basieren, schaffen ohne große Optimierungen mehr als 20 Frames pro Sekunde, was einen sehr flüssigen Spielablauf gewährleistet. Der Cursor bewegt sich nun in Abhängigkeit der Kopf- und Augenbewegungen.

Sprachsteuerung

Wird ein Kind über Kopf und Augen anvisiert, reagiert es nur, wenn auch sein Name gerufen wird. Es erscheint ein Aktionsmenü, das die möglichen Handlungen aufzeigt. Diese werden wieder über eine Spracheingabe ausgewählt und das Kind reagiert entsprechend.

Das Konzept von Krazy Kindergarten sieht eine Kombination aus Sprachsteuerung und Eye-Tracking vor. Zur Umsetzung der Spracherkennung bot sich das Microsoft Speech SDK (SAPI) an, welches auch für die in Windows bereits integrierte Spracherkennung benutzt wird. Grundsätzlich unterscheidet man bei der Spracherkennung zwischen 2 Modi: Dictation und Command-and-Control. Letzteres, also das Erkennen von vordefinierten Kommandos, im Gegensatz zur Analyse von gesprochenem Volltext, basiert auf einer Grammatik, die sämtliche valide Befehle enthält.

Die Krazy Kindergarten Grammatik enthält 2 Regelsätze. Eine zum Erkennen der Namen der Kinder und die andere zum Erkennen der möglichen Anweisungen.

Gameplay und Wegeplanung

Alle Kinder haben unterschiedliche Verhaltensmuster, die grossen Einfluss auf die aktuellen Bedürfnisse haben. Die individuellen Entscheidungen basieren auf komplexen Mustern und adaptiven Entscheidungsregeln. Die Wegfindung wird durch zeitbasierte Standardalgorithmen realisiert.